sd3 diffusers框架基于lite server适配pytorch npu推理指导(6.3.912)-九游平台

stable diffusion(简称sd)是一种基于扩散过程的图像生成模型,应用于文生图场景,能够帮助用户生成图像。

方案概览

本方案介绍了在modelarts lite server上使用昇腾计算资源ascend snt9b开展sd3模型的推理过程。

约束限制

- 本方案目前仅适用于企业客户。

- 本文档适配昇腾云modelarts 6.3.912版本,请参考表1获取配套版本的软件包和镜像,请严格遵照版本配套关系使用本文档。

- 确保容器可以访问公网。

资源规格要求

推荐使用“西南-贵阳一”region上的server资源和ascend snt9b。

软件配套版本

|

分类 |

名称 |

获取路径 |

|---|---|---|

|

插件代码包 |

ascendcloud-6.3.912软件包中的ascendcloud-aigc-6.3.912-xxx.zip 文件名中的xxx表示具体的时间戳,以包名发布的实际时间为准。 |

获取路径:,在此路径中查找下载modelarts 6.3.912 版本。

说明:

如果上述软件获取路径打开后未显示相应的软件信息,说明您没有下载权限,请联系您所在企业的华为方九游平台的技术支持下载获取。 |

镜像版本

本教程中用到基础镜像地址和配套版本关系如下表所示,请提前了解。

|

配套软件版本 |

镜像用途 |

镜像地址 |

配套 |

获取方式 |

|---|---|---|---|---|

|

6.3.912版本 |

基础镜像 |

swr.cn-southwest-2.myhuaweicloud.com/atelier/pytorch_2_1_ascend:pytorch_2.1.0-cann_8.0.rc3-py_3.9-hce_2.0.2409-aarch64-snt9b-20241213131522-aafe527 |

cann_8.0.rc3 pytorch_2.1.0 驱动23.0.6 |

从swr拉取 |

不同软件版本对应的基础镜像地址不同,请严格按照软件版本和镜像配套关系获取基础镜像。

步骤一:检查环境

- 请参考,购买server资源,并确保机器已开通,密码已获取,能通过ssh登录,不同机器之间网络互通。

购买server资源时如果无可选资源规格,需要联系华为云九游平台的技术支持申请开通。

当容器需要提供服务给多个用户,或者多个用户共享使用该容器时,应限制容器访问openstack的管理地址(169.254.169.254),以防止容器获取宿主机的元数据。具体操作请参见。

- ssh登录机器后,检查npu卡状态。运行如下命令,返回npu设备信息。

npu-smi info # 在每个实例节点上运行此命令可以看到npu卡状态 npu-smi info -l | grep total # 在每个实例节点上运行此命令可以看到总卡数

如出现错误,可能是机器上的npu设备没有正常安装,或者npu镜像被其他容器挂载。请先正常安装固件和驱动,或释放被挂载的npu。

- 检查是否安装docker。

docker -v #检查docker是否安装

如尚未安装,运行以下命令安装docker。

yum install -y docker-engine.aarch64 docker-engine-selinux.noarch docker-runc.aarch64

- 配置ip转发,用于容器内的网络访问。执行以下命令查看net.ipv4.ip_forward配置项的值,如果为1,可跳过此步骤。

sysctl -p | grep net.ipv4.ip_forward

如果net.ipv4.ip_forward配置项的值不为1,执行以下命令配置ip转发。sed -i 's/net\.ipv4\.ip_forward=0/net\.ipv4\.ip_forward=1/g' /etc/sysctl.conf sysctl -p | grep net.ipv4.ip_forward

步骤二:下载依赖代码包并上传到宿主机

下载华为侧插件代码包ascendcloud-aigc-6.3.912-xxx.zip文件,获取路径参见表1。本案例使用的是解压到子目录aigc_inference/torch_npu/diffusers/0.29.2/目录下的所有文件,将该目录上传到宿主机上。

步骤三:构建镜像

基于官方提供的基础镜像构建自定义镜像diffusers-sd3-inference:0.0.1。参考如下命令编写dockerfile文件。镜像地址{image_url}请参见表2。

from {image_url}

run mkdir /home/ma-user/diffusers

copy --chown=ma-user:ma-group diffusers/0.29.2 /home/ma-user/diffusers

workdir /home/ma-user/diffusers

run dos2unix diffusers_sd3.patch

run cd /home/ma-user/diffusers && sh prepare.sh

run cp attention_processor.py /home/ma-user/anaconda3/envs/pytorch-2.1.0/lib/python3.9/site-packages/diffusers/models/attention_processor.py

run pip install transformers

run pip install accelerate

run pip install sentencepiece

构建自定义镜像diffusers-sd3-inference:0.0.1。

docker build -t diffusers-sd3-inference:0.0.1 .

步骤四:启动镜像

docker run -itd --name ${container_name} -v /sys/fs/cgroup:/sys/fs/cgroup:ro -v /etc/localtime:/etc/localtime -v /usr/local/ascend/driver:/usr/local/ascend/driver -v /usr/local/bin/npu-smi:/usr/local/bin/npu-smi --shm-size 60g --device=/dev/davinci_manager --device=/dev/hisi_hdc --device=/dev/devmm_svm --device=/dev/davinci0 --security-opt seccomp=unconfined --network=bridge diffusers-train:0.0.1 bash

参数说明:

- --name ${container_name}:容器名称,进入容器时会用到,此处可以自己定义一个容器名称。

- --device=/dev/davinci0:挂载npu设备,该推理示例中挂载了1张卡davinci0。

- driver及npu-smi需同时挂载至容器。

- 不要将多个容器绑到同一个npu上,会导致后续的容器无法正常使用npu功能。

步骤五:进入容器

docker exec -it ${container_name} bash

步骤六:启动推理

本章节介绍sd3模型的推理过程。使用官方提供的已经训练好的模型进行推理,输入prompt生成指定像素的图片。

- 使用如下命令登录huggingface,并输入个人账号的token:

huggingface-cli login

- 执行如下命令运行推理脚本启动sd3服务:

#配置环境变量 export pytorch_npu_alloc_conf=expandable_segments:true python run_inference.py

参数说明:

- height、width: 指定生成图片的长和宽,例如:512、960、1024

- prompt_list: prompt列表,可以自行修改。

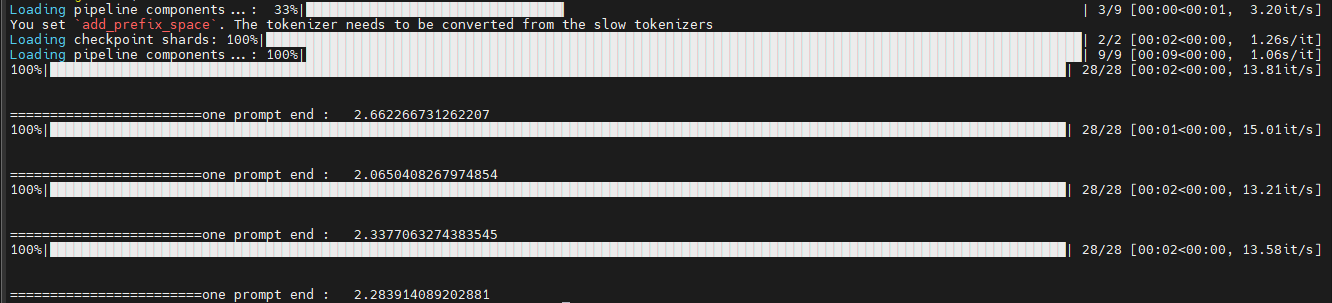

推理执行成功如下图所示。

图1 推理执行成功

相关文档

意见反馈

文档内容是否对您有帮助?

如您有其它疑问,您也可以通过华为云社区问答频道来与我们联系探讨